DeepSeek

模型 ID: deepseek-v4-flash

DeepSeek V4 Flash

- 总上下文

- 256K

- 最大输出

- 64K

- 标准输入价格

- 需申请

- 标准输出价格

- 需申请

- Batch 输入价格

- 需申请

- Batch 输出价格

- 需申请

同一个兼容 OpenAI 的入口接入托管与开源模型,并把路由控制、成本治理、签名审计和 Batch 档位真正做成生产能力

兼容 OpenAI SDK,无需修改现有代码,60 秒内完成接入

先创建账户并复制 API Key,如有邀请码再激活试用额度

batchin-sk-xxxx...使用 OpenAI SDK,只需修改一行代码

client = OpenAI( base_url="https://batchin-api.onrender.com/v1", api_key="YOUR_KEY" )

53 个模型覆盖文本、代码、图像、视频、音频和向量能力,并支持流式输出、批量推理和审计追踪

from openai import OpenAI

client = OpenAI(

base_url="https://batchin-api.onrender.com/v1",

api_key="YOUR_BATCHIN_KEY"

)

response = client.chat.completions.create(

model="glm-5.1",

messages=[{"role": "user", "content": "Summarize this meeting"}]

)高性价比、稳定可靠,适用于任何规模团队,接入简单。

DeepSeek

模型 ID: deepseek-v4-flash

Qwen / Alibaba

模型 ID: qwen3-next-80b-a3b

Moonshot AI

模型 ID: kimi-k2-6

DeepSeek

模型 ID: deepseek-v3-2

OpenAI OSS

模型 ID: gpt-oss-120b

Qwen / Alibaba

模型 ID: qwen3-coder-30b-a3b

根据模型、用量和竞品进行成本估算。

公开站点仅展示 BatchIn 估算成本

由于竞品价格覆盖并非对所有模型都可验证,首页不再展示精确节省百分比。请以模型详情页中的价格说明、直通线路标注与 亚洲 / Batch 标注为准

BatchIn

¥110.88

按人民币展示

模型页价格说明

Standard relay $0.28/M. Public site shows Asia public floor and batch lanes. Asia Shared and Asia Dedicated available on request.

价格口径

优先展示 Batch / 亚洲 / 直通线路 的公开口径

月度 BatchIn 成本估算

首页估算器只显示 BatchIn 公开成本,不显示未经逐模型核验的竞品节省百分比

围绕托管推理、批处理、审计追踪、多模态和专属容量构建真正差异化的产品。

用路由策略、保留边界和审计追踪构建研究、红队、创意和复杂工作流智能体。

一次处理数百万份文档。支持 3 档优先级,Fill 路径可把大规模离线任务成本压到最低。

为模型输出、调用链路、路由决策和关键工作流保留可复核证据,支持回放、追踪、审计与企业级交付。

用一个平台覆盖文本、代码、图像、视频、语音和向量任务,不需要拆分多套基础设施。

围绕 USDC、Stripe 和链下账本,提供可核验的充值、账单与凭证链路。

为稳定高负载推理预留专属容量。你的模型、你的运行栈、你的运维规则。

以统一入口管理模型访问、路由策略与成本可见性。

告诉我们你的推理场景、部署边界和交付要求,我们会安排合适的接入路径。

接入咨询

当前 customer preview 不提供首页直接提交表单。请通过邮件说明团队、模型需求、是否需要中继 / BYOK / 私有容量 / VaaS,我们会回复接入建议。

邮件中建议附上

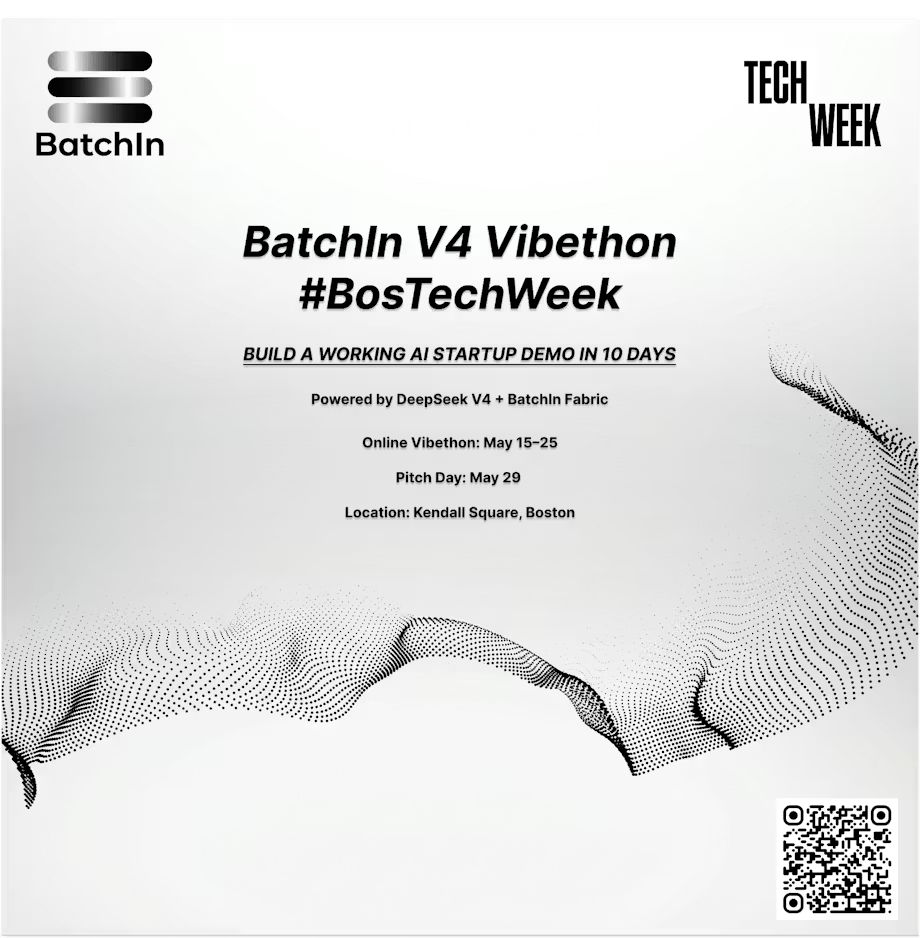

参加我们的黑客松、线上研讨或构建挑战赛

使用 DeepSeek V4 远程构建,并在波士顿科技周 Demo Day 路演。主报名走 BatchIn,Demo Day 确认出席走 Partiful

通过 BatchIn API 使用 GLM-5.1(SWE-Bench Pro #1、8 小时自主编码)与 DeepSeek V4(1T MoE,开放后可用)进行构建。3 天,50–100 位开发者,$2,000 API Credits 奖池。

了解如何使用 BatchIn 的 Batch API 将 AI 推理成本降低一半。现场演示、真实客户案例和工程团队 Q&A。